Highlight

Samen succesvol – met sterke partners.

Samen met onze partners creëren we innovatieve oplossingen en echte impact voor uw digitale toekomst.

Onze Partnersfebruari 17, 2022

⏰ Geschatte leestijd: 6 minuten

In een reeks artikelen lichten CRO-consultants Lotte Mulder en Daisy van der Knaap de belangrijkste onderdelen van een succesvol conversie-optimalisatie traject uit, met vandaag het laatste onderdeel: A/B testen.

Na het raadplegen van verschillende databronnen en je actiepunten te hebben geprioriteerd, is het tijd om het actiepunt op te pakken en aanpassingen door te voeren. Maar voordat je dat doet, is het wel zo fijn om een grote mate van zekerheid te hebben dat aan kan geven of de aanpassingen ook daadwerkelijk geld gaan opleveren of dat deze ten koste gaan van jouw omzet.

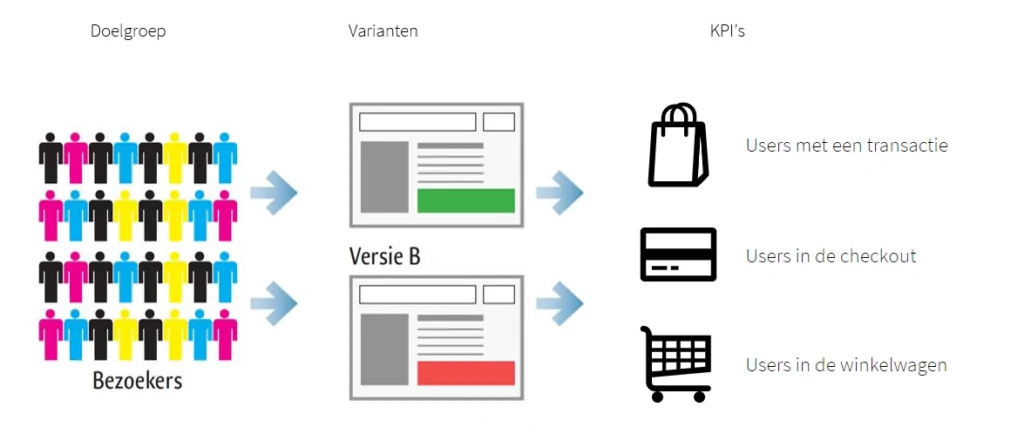

Binnen een succesvol conversie-optimalisatie traject proberen we daarom zoveel mogelijk te A/B testen. Simpel gezegd is een A/B test een vorm van splittesten waarbij twee (of meer) varianten afwisselend aan de bezoekers getoond worden. Bij twee varianten ziet 50% van de bezoekers variant A (vaak de huidige webshop) en de andere 50% van de bezoekers ziet variant B (in de meeste gevallen een aanpassing aan de webshop). Tijdens zo’n A/B test wordt het conversieratio per variant gemeten en kun je na afloop van de test precies aflezen welke variant beter werkt voor jouw doelgroep.

Door een A/B test uit te voeren weten we met statistische zekerheid of de aanpassing aan de webshop ook daadwerkelijk in een hogere omzet resulteert. Het is daarbij natuurlijk wel de bedoeling dat je de aanpassing ook structureel doorvoert op de webshop.

Echter werkt een A/B test ook de andere kant op. Als je ziet dat juist de huidige webshop (variant A) de hoogste omzet oplevert, dan voer je de aanpassingen van variant B niet door. Op deze manier voorkom je aanpassingen die juist voor een daling in je omzet zorgen.

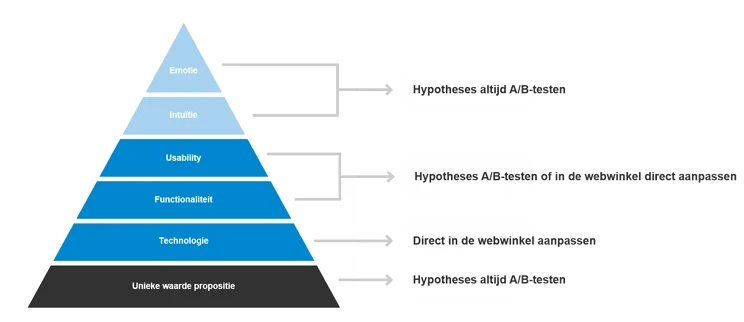

Theoretisch gezien moet je alle aanpassingen A/B testen voordat je deze op je webshop live zet. Toch zijn er ook een aantal aanpassingen waarbij testen niet noodzakelijk zijn. Technische aanpassingen zijn hier een voorbeeld van. Technische obstakels zijn zo duidelijk aanwezig dat deze direct aangepast moeten worden. Denk hierbij aan 404-errors of site speed issues. Deze obstakels moet je direct wegnemen zonder deze te testen. Ook zijn er functionele aanpassingen, zoals het verbeteren van de interne zoekfunctie, die direct doorgevoerd kunnen worden in plaats van deze eerst te testen.

Hypothese & testplan opstellen

Bepalen van de testduur

Het is ook belangrijk om vooraf te bepalen hoe lang de A/B test moet draaien. Een te korte testduur kan resulteren in te weinig data om betrouwbare conclusies te kunnen trekken. Dit is natuurlijk zonde, want dan heb je de test eigenlijk voor niets gedraaid. Een te lange testduur kan juist zorgen voor vertroebeling van de data, omdat bijvoorbeeld een deel van de bezoekers hun cookies regelmatig verwijderd. Daarnaast is het zonde van de tijd om een A/B test langer te draaien dan noodzakelijk. Door te kijken naar het aantal gebruikers dat wekelijks de pagina bezoekt, het aantal transacties in die week, het aantal varianten in de test en het minimaal detecteerbaar effect (het effect dat je terug wilt zien op het conversieratio als gevolg van de A/B test) is te bepalen hoe lang de test moet draaien.

De A/B test draaien

Nadat de hypothese is vastgesteld, het testplan is gemaakt en is bepaald hoe lang de A/B test moet draaien, kan de A/B test gebouwd worden. Hiervoor maken we gebruik van een A/B testingtool. In deze tool kan je ook direct de A/B test live zetten zodra deze klaar is voor livegang. Een bekende valkuil van A/B testen is het vroegtijdig stoppen of langer door laten lopen van de test tot een positief effect is gevonden. Dit wordt ook wel confirmation bias genoemd. Hiermee wacht je als het ware tot het moment dat de test positief uitvalt, waarmee je je hypothese kunt bevestigen. Dit doet af aan de betrouwbaarheid van de resultaten en wil je dus te allen tijde voorkomen.

Testresultaten analyseren

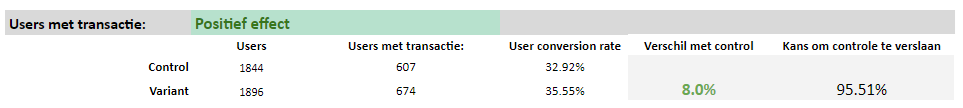

Na de looptijd van de A/B test is het tijd om de testresultaten te analyseren. Dit doen wij door voor iedere van tevoren bepaalde KPI te kijken naar de uplift in het conversieratio, en deze voor de verschillende varianten met elkaar te vergelijken aan de hand van de eerder benoemde statistische zekerheid. Met deze methode kijken we hoe groot de kans is dat de variant met aanpassing meer omzet zal opleveren dan de variant zonder aanpassing. Als de statistische zekerheid van de nieuwe variant groter is dan 80%, adviseren we om de variant structureel door te voeren op de website. Hetzelfde geldt natuurlijk ook de andere kant op. Als de statistische zekerheid van de nieuwe variant niet groter is dan 80%, adviseren we om deze variant niet door te voeren. Natuurlijk is het ook altijd goed om naar de andere KPI’s te kijken om de resultaten van de test beter te kunnen begrijpen en interpreteren, zodat je deze inzichten kan meenemen in eventuele vervolgtesten.

Vergeet daarbij ook niet de inzichten van de A/B test met de gehele organisatie te delen. Op deze manier profiteert iedereen van de nieuwe kennis.

In dit artikel las je over het laatste essentiële onderdeel van een succesvol conversie-optimalisatie traject: AB testen. Hiermee ben je op weg naar een webshop met structureel minder obstakels. Dit betekent overigens niet dat het hier eindigt. Het conversie-optimalisatie traject is een doorlopend proces van rapporteren, analyseren, prioriteren en A/B testen.

Onverhoopt toch een van de delen gemist? Lees hier het belang van de databronnen en het prioriteren van databronnen.

Nieuwsbrief

Inschrijven